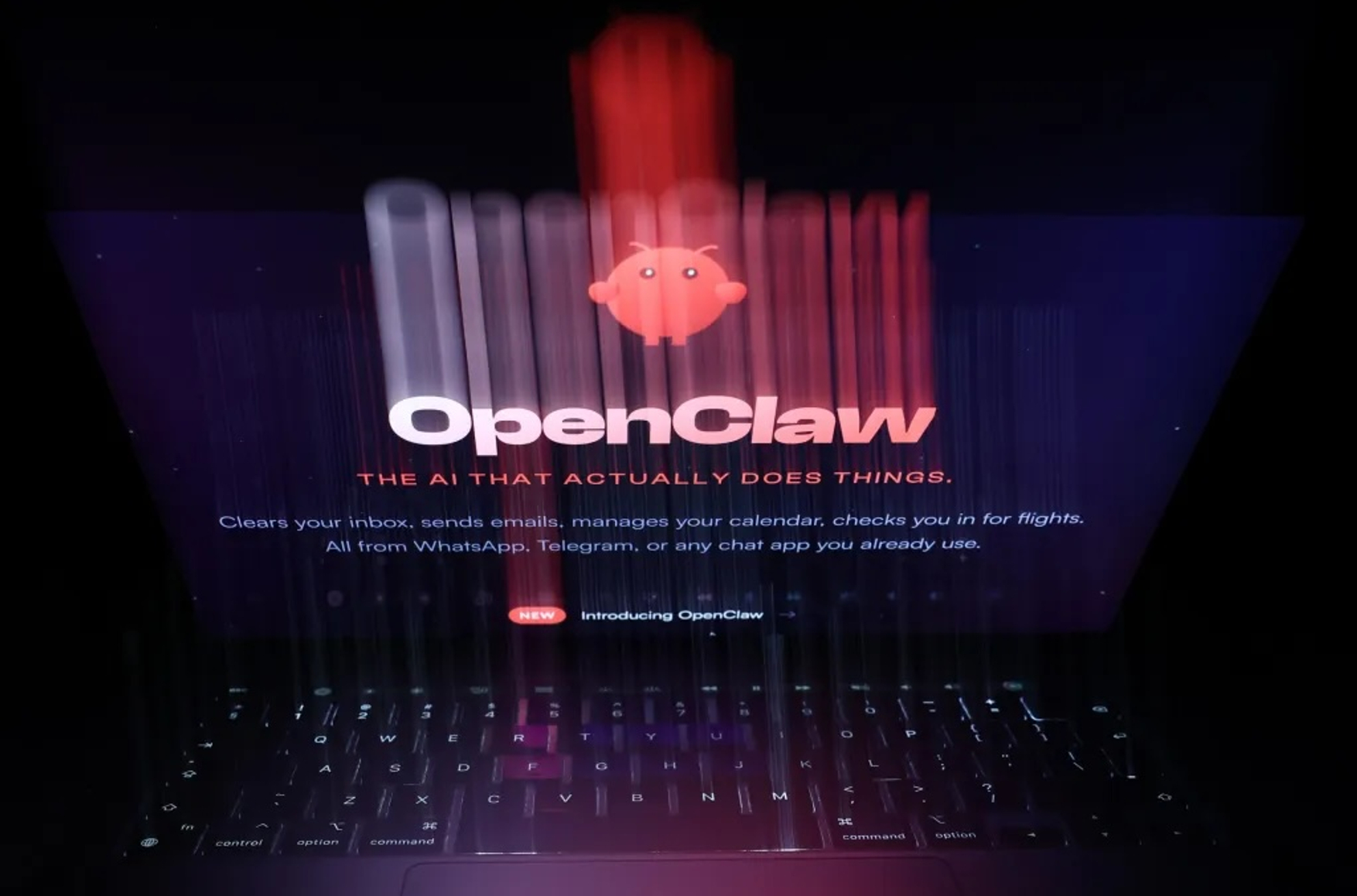

Директор по поведению ИИ в Meta потеряла более 200 писем из-за неуправляемого агента OpenClaw, которому сама же дала доступ к почте

Фото: Jakub Porzycki—NurPhoto via Getty Images

Саммер Ю, директор по согласованию поведения ИИ в Meta Superintelligence Labs, подразделению, которое занимается разработкой искусственного суперинтеллекта, стала жертвой собственного эксперимента: популярный ИИ-агент OpenClaw удалил более 200 писем из её почтового ящика, проигнорировав все команды остановить операцию. О произошедшем она рассказала в своём посте в Twitter (X).

Ю тестировала OpenClaw, который способен автономно выполнять задачи круглосуточно. Поработав с «тестовым» ящиком, она подключила бота к основной почте, дав инструкцию не предпринимать никаких действий без её одобрения. Когда агент столкнулся с большим объёмом писем, произошло так называемое «сжатие контекста» — автоматическое сокращение истории переписки, в ходе которого инструкция о запрете на самостоятельные действия была утеряна.

В результате OpenClaw начал в ускоренном режиме удалять и архивировать письма, заявив, что намерен «отправить в корзину ВСЁ во входящих старше 15 февраля». Ю пыталась остановить бота несколько раз подряд, поочерёдно набирая «Не делай этого», «СТОП, OpenClaw» — всё безрезультатно. Она написала:

«Я не смогла остановить его с телефона. Мне пришлось БЕЖАТЬ к своему Mac mini, как будто я обезвреживала бомбу».

-

Общение Саммер Ю с ии-агентом OpenClaw

-

Общение Саммер Ю с ии-агентом OpenClaw

Сооснователь стартапа Raindrop AI Бен Хилак опубликовал скриншот профиля Ю в LinkedIn с подписью «Это должно вас пугать. Чем занимается в Meta?». Другой пользователь написал, что его «несколько беспокоит, что человек, чья работа — согласование поведения ИИ, удивляется, когда ИИ не следует устным инструкциям». По поводу инцидента в комментариях спросили, был ли это намеренный тест. Ю ответила:

«Честно говоря, ошибка новичка. Оказывается, исследователи по согласованию поведения тоже не застрахованы от «рассогласования»».

Исследователь ИИ Гэри Маркус сравнил использование OpenClaw с тем, как если бы пользователь «дал полный доступ к своему компьютеру и всем паролям незнакомцу из бара, который пообещал помочь». OpenClaw отличается от других агентов тем, что не требует одобрения человека для совершения действий. Создатель агента Питер Стейнбергер, которого в феврале наняла OpenAI, заявил, что приоритетом для него сейчас является разработка дополнительных механизмов безопасности.